Opiniones

Más allá de la detección: lo que Claude Mythos y Project Glasswing auguran para el futuro de AppSec

Escritor y editor

Updated

10 min

Por estos días, el sector de la ciberseguridad concentra su atención en una narrativa peculiar y aparentemente de alto riesgo: una IA autónoma capaz de detectar y explotar vulnerabilidades a una escala que antes parecía reservada a los operadores estatales. En el centro de esta conversación se encuentran dos iniciativas interconectadas de Anthropic, Claude Mythos Preview y Project Glasswing, y las reacciones que han suscitado van desde la alarma hasta el rechazo. Ninguna de estas reacciones resulta particularmente útil.

Si bien la maquinaria de marketing que rodea estos lanzamientos es formidable, las implicaciones potenciales para la seguridad de las aplicaciones están plagadas tanto de avances técnicos genuinos como de incertidumbre estratégica. En lugar de preguntarnos si Mythos es revolucionario o exagerado, surge una pregunta más útil: ¿qué revela este momento sobre hacia dónde se dirige la seguridad de aplicaciones? Y, lo que es más importante, ¿qué exige esto a las organizaciones que necesitan defender sistemas reales en la actualidad?

Lo que Anthropic puso sobre la mesa

Claude Mythos Preview se describe como un modelo de vanguardia, optimizado específicamente para tareas de razonamiento de alto nivel y de seguridad informática. Mientras que los LLMs anteriores se centraban principalmente en el análisis estático para detectar, por ejemplo, inyecciones SQL típicas en fragmentos de código, Mythos funciona como un sistema autónomo ("agéntico"). Su aspecto más llamativo no radica en una sola característica sino en la combinación de capacidades: lee y razona sobre bases de código enormes, formula hipótesis sobre vulnerabilidades, comprueba esas hipótesis de forma dinámica, encadena múltiples debilidades en rutas de ataque viables y genera exploits funcionales junto con informes reproducibles.

Sin embargo, como señala Rafael Álvarez, cofundador de Fluid Attacks, en su blog personal, este tipo de capacidad no surge de un modelo por sí solo, sino de un sistema más amplio: un armazón que rodea un sistema en ejecución, su código fuente, herramientas deterministas que el modelo orquesta… y un humano que ensambla y valida los resultados.

El flujo de trabajo de Mythos suele estructurarse de la siguiente manera: el proyecto en cuestión se carga en un contenedor seguro, aislado de Internet, en el que operan múltiples instancias del modelo. A continuación, el modelo analiza todo el código fuente y clasifica los archivos según su relevancia en materia de seguridad en una escala del 1 al 5 (p.ej., un archivo que analiza datos sin procesar de Internet recibe un "5", mientras que un archivo de configuración podría recibir un "1"). Mediante Claude Code, el modelo formula hipótesis sobre posibles fallos, escribe lógica de depuración, ejecuta el código para confirmar sus sospechas y repite el proceso.

La etapa de priorización también es clave para ampliar el alcance de las evaluaciones. En lugar de analizar repositorios completos de manera uniforme, el sistema clasifica los archivos según la probabilidad de que contengan fallas explotables. Asigna primero agentes paralelos a las áreas de mayor riesgo, lo que reduce la duplicación y aumenta la eficiencia en bases de código de gran tamaño.

Cuando encuentra algo, Mythos construye de forma autónoma un exploit de prueba de concepto. A continuación, una instancia independiente del agente actúa como juez, revisando cada hallazgo y filtrando los problemas menores o de poco interés, de modo que solo se mantengan los resultados de alta gravedad, que son validados por evaluadores humanos antes de su divulgación. Según se informa, en evaluaciones internas, el modelo ha logrado identificar vulnerabilidades que habían persistido durante décadas, incluyendo problemas en sistemas operativos y librerías ampliamente implementadas que ya habían sido sometidas a un escrutinio exhaustivo con otros métodos.

Es difícil ignorar tales reportes. Por ejemplo, Anthropic informa de que Mythos detectó una vulnerabilidad de 27 años de antigüedad en el núcleo de OpenBSD relacionada con las opciones TCP SACK, así como un error de 16 años en FFmpeg que había sobrevivido a millones de pruebas automatizadas. Según señala esta compañía, el modelo también encadenó varias vulnerabilidades del núcleo de Linux para lograr por sí mismo una escalada de privilegios locales. Además, dice que la tasa de éxito en la generación de exploits funcionales se sitúa por encima del 72%, lo que supone un salto espectacular con respecto a los modelos anteriores (incluyendo el reciente Opus 4.6), que tenían grandes dificultades con las vulnerabilidades de día cero.

Por otro lado, Project Glasswing es la respuesta defensiva a las capacidades antes mencionadas. Consciente de que lanzar una herramienta de este tipo sin medidas de seguridad podría tener consecuencias catastróficas, Anthropic formó un consorcio de empresas de tecnología y seguridad, entre las que se incluyen AWS, Google, Microsoft, NVIDIA, Cisco, CrowdStrike y Palo Alto Networks. La iniciativa cuenta con el respaldo de 100 millones de dólares en créditos de uso de modelos y 4 millones de dólares en donaciones a organizaciones de seguridad de código abierto como Alpha-Omega y OpenSSF.

El objetivo declarado es brindar a estos socios y a los mantenedores de código abierto acceso a modelos como Mythos para que puedan detectar y corregir vulnerabilidades en infraestructuras de software crítica antes de que los atacantes maliciosos puedan sacar provecho de capacidades similares. A primera vista, esto se asemeja a colaboraciones anteriores de la industria. Sin embargo, la premisa subyacente es diferente: si el descubrimiento de vulnerabilidades se vuelve drásticamente más fácil y rápido, todo el manual de estrategias defensivas debería cambiar.

En la práctica, Glasswing no es solo un acuerdo de colaboración, sino también un entorno de pruebas operativas. Las organizaciones participantes utilizan Mythos Preview para realizar tareas como pruebas de caja negra de binarios, análisis de seguridad de terminales y detección de vulnerabilidades tanto en sistemas propietarios como en sistemas de código abierto, y los resultados se incorporan a procesos coordinados de divulgación y remediación.

Evidencia, escepticismo y timing estratégico

El debate en torno a Mythos se basa en una mezcla de pruebas verificables e incertidumbres. Por un lado, las afirmaciones sobre cambios de paradigma impulsados por la IA se han convertido en algo habitual, y muchos profesionales desconfían de los discursos de marketing envueltos en una ambición técnica. Por otro lado, hay pruebas tangibles de vulnerabilidades reales descubiertas y remediadas en sistemas de uso generalizado, y organizaciones acreditadas se han movilizado en torno a una preocupación compartida.

Se trata de contribuciones concretas, no de demostraciones hipotéticas. Aun así, las pruebas públicas siguen siendo mucho más escasas que el conjunto de afirmaciones (al parecer, los plazos de divulgación responsable impiden una inspección completa). Anthropic afirma que menos del 1% de las potenciales vulnerabilidades descubiertas hasta ahora se han corregido por completo, y que ha identificado "miles" de vulnerabilidades de severidades alta y crítica. Sin embargo, en esta etapa, el registro público consiste principalmente en un conjunto limitado de compromisos de hash SHA-3 —que suman poco más de 15 hasta ahora— y solo en un CVE atribuible explícitamente a Glasswing: CVE-2026-4747, listado en el NVD como un desbordamiento de búfer basado en la pila de FreeBSD RPCSEC_GSS.

También siguen sin estar claros detalles operativos clave. Álvarez señala que métricas como las tasas de falsos positivos, el costo en tokens y los flujos de validación no se han divulgado, lo que dificulta evaluar la verdadera eficiencia y fiabilidad del proceso en la práctica.

Esta ambigüedad alimenta un ciclo familiar de exageración y contraexageración, en el que coexisten tanto el optimismo como el miedo exagerados. Vale la pena mantener un escepticismo saludable y preguntarse por qué Anthropic eligió este momento específico para presentar su modelo como demasiado peligroso para su lanzamiento público. La empresa, por ejemplo, se encuentra en una intensa carrera con OpenAI por el dominio del mercado y, según se informa, se encamina a una oferta pública inicial (OPI). Un modelo posicionado como demasiado poderoso para ser lanzado es una narrativa convincente para los inversionistas y para asegurar financiamiento en los años venideros. Algunos críticos han calificado esto de "criti-hype", una dinámica en la que las advertencias sobre los peligros de una tecnología inflan su valor percibido. Si una herramienta es lo suficientemente poderosa como para desestabilizar Internet, según este argumento, debe serlo también para justificar una valoración de miles de millones de dólares. Otros observadores ven todo esto como señales tempranas de un punto de inflexión genuino.

Una lectura equilibrada tiene en cuenta ambos elementos. Es innegable que hay una estrategia de marketing detrás, pero también hay suficiente fondo técnico como para que merezca una atención seria. El paralelismo histórico resulta instructivo: en su momento, se consideró que GPT-2 era demasiado peligroso como para lanzarlo al mercado, pero finalmente se puso a disposición del público sin que se produjera la catástrofe prevista. Algunos analistas sospechan que Mythos se encuentra simplemente en una fase beta, y que el discurso sobre la seguridad sirve de excusa conveniente para pulir los detalles con socios de confianza antes de un lanzamiento más amplio. En todo caso, todo esto genera una tensión natural: se pide al sector que se prepare para hacer frente a capacidades que aún no pueden evaluarse por completo.

Esa tensión se agudizó aún más poco después de los anuncios de Mythos y Glasswing. Algunos investigadores informaron de lo que describieron como una falla sistémica en el protocolo de contexto de modelo (MCP) de Anthropic, relacionada con configuraciones basadas en STDIO que podrían dar lugar a la ejecución de comandos arbitrarios en las implementaciones afectadas. Según ellos, el problema afectaba a gran parte de la cadena de suministro de IA, y Anthropic confirmó que ese comportamiento es parte del diseño, dejando la sanitización en manos de los desarrolladores en lugar de modificar el protocolo. Esto siguió a otro incidente en el que Claude Code se distribuyó a npm con un mapa de origen no intencionado que expuso más de 500 000 líneas de código fuente propietario, lo que Anthropic atribuyó a un error humano en lugar de a una brecha de seguridad. Ninguno de los dos episodios refuta las capacidades de Mythos, pero ambos refuerzan un punto incómodo: incluso los creadores de herramientas de seguridad de vanguardia siguen estando sujetos a las mismas realidades caóticas del diseño de software, las cadenas de suministro, los procesos de lanzamiento y los descuidos humanos que todos los demás.

Acceso restringido y la cuestión de la equidad

La decisión de limitar Mythos a un grupo cerrado de socios seleccionados plantea otra serie de preocupaciones. Al concentrar las herramientas defensivas más poderosas en manos de un consorcio de gigantes tecnológicos, Anthropic corre el riesgo de crear un panorama de seguridad de dos niveles. Las grandes empresas con los recursos para participar en Glasswing tendrán acceso anticipado a estas capacidades. Las pequeñas y medianas empresas, incapaces de absorber los futuros precios o los requisitos de infraestructura para ejecutar estos agentes, podrían encontrarse en una situación de desventaja permanente, enfrentándose aún a atacantes potenciados por IA pero sin defensas de nivel de IA.

También hay preguntas sin respuesta sobre la gobernanza y la dependencia. Las organizaciones que dependen de herramientas de la clase Mythos a través de Glasswing se vuelven dependientes de las decisiones de Anthropic sobre el acceso, los precios y la disponibilidad continua. Una centralización de este tipo merece un análisis minucioso, especialmente cuando lo que está en juego son infraestructuras críticas.

El verdadero cambio: el descubrimiento se vuelve un bien común

La consecuencia más importante de Mythos y Glasswing no es el descubrimiento de nuevos errores. Es la devaluación del descubrimiento en sí mismo. Nos acercamos a una realidad en la que la detección de vulnerabilidades es abundante y barata, dejando así de ser el valor diferenciador de una solución AppSec, pero la capacidad para solucionar esos problemas sigue siendo parcialmente humana, finita y, en el caso del código abierto, en gran medida voluntaria. El cuello de botella pasa del investigador de seguridad al responsable del mantenimiento del software. Este cambio también expone un problema más inmediato: la mayoría de las organizaciones ya conocen muchas de sus vulnerabilidades y simplemente no las están remediando. Como observa Álvarez, el problema a menudo no es el descubrimiento, sino la disciplina: los equipos saben exactamente qué está roto y no lo están arreglando.

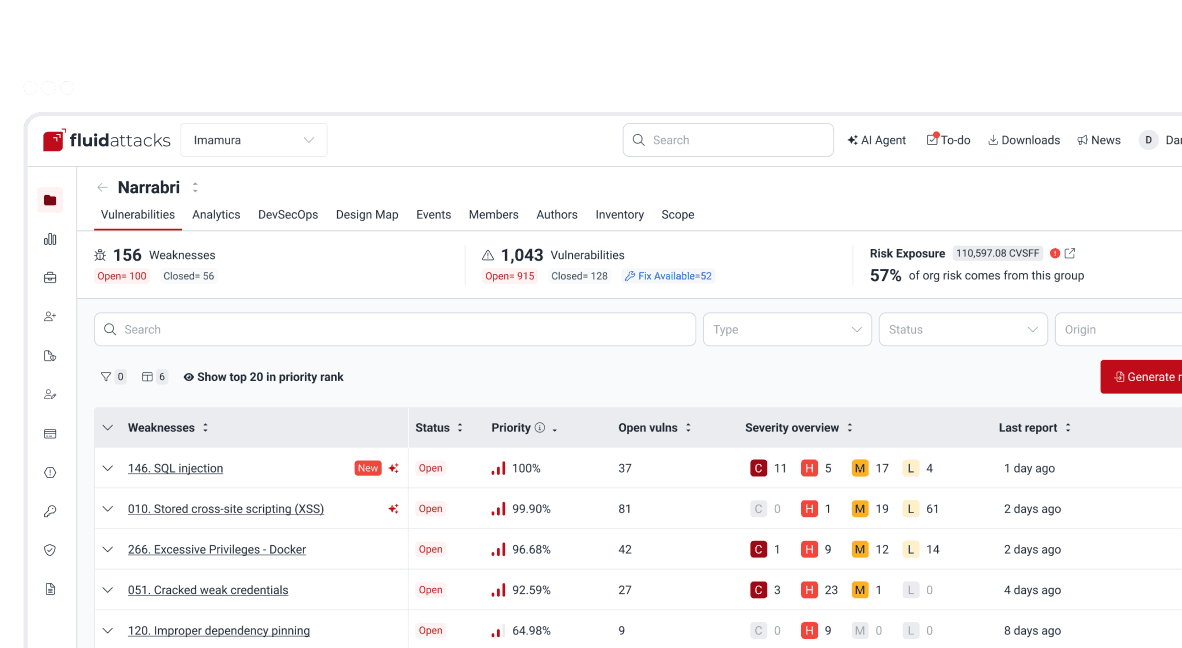

Esto no es teórico. Muchas organizaciones ya acumulan más hallazgos de los que pueden abordar razonablemente. Modelos como Mythos acelerarían ese patrón hasta el extremo. Las herramientas se hicieron más rápidas, la cobertura mejoró y la pila de hallazgos sin resolver siguió creciendo. Tal vez ahora lo que falta no es más detección. Es la capacidad de entender y decidir qué problemas son más importantes, priorizarlos según el contexto, solucionarlos de forma segura y verificar que el riesgo realmente disminuyó. Eso también requiere una vista normalizada y centralizada de los hallazgos de todas las fuentes; de lo contrario, los informes generados por IA se convierten en un silo más que se suma a los resultados de los escáneres, los informes de pruebas de penetración, los tickets y las hojas de cálculo.

Anthropic también señala que las pruebas de rendimiento tradicionales ya no son suficientes para evaluar estos sistemas, ya que los modelos pueden memorizar vulnerabilidades conocidas. En su lugar, se centran en el descubrimiento de vulnerabilidades de día cero como un indicador más fiable de la capacidad real, ya que dichos hallazgos no pueden provenir de los datos de entrenamiento.

La carga para los mantenedores y el retraso de CVE

Para los desarrolladores de código abierto, la avalancha de informes de vulnerabilidades generados por IA es un arma de doble filo. Los responsables de mantenimiento de algunos proyectos han reconocido que los informes de IA están mejorando en calidad, pasando de ser ruido de fondo a algo realmente útil. Pero incluso un informe de alta calidad requiere tiempo humano para validarlo, integrarlo y probarlo. La capacidad para absorber ese volumen de hallazgos y subsanarlos no crece al mismo ritmo que el descubrimiento.

Además, el ecosistema CVE existente ya está bajo presión. Un aumento exponencial en el descubrimiento de vulnerabilidades podría desbordar la infraestructura de clasificación, generando atrasos que se prolongarían durante meses. Esto crea una peligrosa "brecha de cumplimiento": los calendarios tradicionales de aplicación de parches se vuelven obsoletos cuando un adversario puede pasar del descubrimiento a la explotación en cuestión de minutos.

IA en ambos bandos

La detección de vulnerabilidades impulsada por la IA no es una posibilidad futura. Los adversarios ya están utilizando la IA para ampliar sus operaciones. Los modelos no necesitan alcanzar capacidades del nivel de Mythos para ser eficaces; incluso los sistemas con capacidades moderadas aceleran el reconocimiento, el desarrollo de exploits y la automatización de los ataques. Ya hemos visto esquemas automatizados de extorsión de datos y campañas de "vibe hacking" que antes requerían equipos criminales completos. Los defensores se ven obligados a responder con herramientas similares, pero la velocidad por sí sola no basta. Las organizaciones también deben mejorar la calidad de la toma de decisiones bajo presión de tiempo.

Cabe señalar que una de las capacidades más relevantes, desde el punto de vista técnico, de Mythos es la de encadenar múltiples vulnerabilidades para eludir mecanismos de defensa en profundidad, como KASLR (kernel address space layout randomization) o el aislamiento en entornos de prueba. Esto refleja un cambio en el que las medidas de mitigación basadas en aumentar el esfuerzo del atacante, en lugar de imponer restricciones estrictas, podrían resultar menos efectivas frente a los flujos de trabajo asistidos por IA.

Incertidumbres críticas

A pesar del impulso actual, hay varias limitaciones que deben tenerse en cuenta. En primer lugar, ningún sistema, ya sea de IA o de otro tipo, puede garantizar de manera realista una cobertura completa de las vulnerabilidades. Las diferentes técnicas detectan distintos tipos de problemas y los falsos negativos siguen siendo una preocupación fundamental. También existe una limitación más profunda. Como explica Álvarez, la seguridad del software no es un problema totalmente resoluble en el caso general: determinar si un programa está libre de vulnerabilidades está sujeto a los mismos límites teóricos descritos por el teorema de Rice. En la práctica, esto significa que cualquier herramienta —basada en IA o no— siempre operará mediante aproximaciones, equilibrando falsos positivos y falsos negativos.

En segundo lugar, la suposición de que la detección se convertirá en algo trivial puede ser exagerada. Si bien la IA puede mejorar significativamente la eficiencia, la validación a gran escala y de alta confianza sigue requiriendo recursos, contexto y juicio humano. Y es posible que el ecosistema más amplio, en particular los mantenedores de código abierto, simplemente no tenga la capacidad de absorber el mayor volumen de hallazgos.

Adicionalmente, los centros de datos cuentan con procesos de aplicación de parches relativamente maduros, pero el mundo de la tecnología operativa, el IoT y los sistemas ciberfísicos no. No existe un equivalente a Windows Update para el controlador de una bomba de una planta de tratamiento de agua. Si el descubrimiento de vulnerabilidades se vuelve independiente del sistema operativo, pero la corrección sigue siendo específica del hardware y del entorno, nos enfrentaremos a una ola de vulnerabilidades de día cero en sistemas que nunca fueron diseñados para recibir parches a gran escala.

Qué significa esto para los programas de seguridad

En conjunto, estas tendencias apuntan a un cambio estructural, no a un simple avance tecnológico. De ello se derivan varias consecuencias potenciales:

Las pruebas de penetración por parte de expertos y el escaneo de vulnerabilidades por parte de herramientas determinísticas seguirán perdiendo valor considerablemente si no trabajan de la mano con modelos de IA avanzados y si están fuera de programas de seguridad integrales.

Surgirán nuevos modelos de servicio —como el ya establecido y ofrecido por Fluid Attacks años atrás— en torno a soluciones que integren la detección, la priorización, la corrección y la verificación en un flujo de trabajo continuo.

Los roles de seguridad evolucionarán y las habilidades más demandadas pasarán de detectar vulnerabilidades en los sistemas a coordinar agentes de IA, validar con precisión sus resultados y tomar decisiones de gran impacto sobre la priorización y mitigación de riesgos.

La pregunta clave que se plantean las organizaciones al evaluar a los proveedores de seguridad ya no se centrará tanto en las capacidades de detección de vulnerabilidades, sino más bien en la capacidad de validar con precisión los hallazgos, priorizarlos en función del contexto y promover una remediación rápida y continua a gran escala.

A medida que la seguridad impulsada por la IA se vuelva más frecuente, se ampliarán los requisitos normativos de auditabilidad, supervisión y rendición de cuentas. La Ley de IA de la UE y los marcos del NIST ya apuntan en esta dirección, y el "cuidado razonable" exigirá cada vez más la supervisión humana documentada de los hallazgos automatizados.

Una IA autónoma que descubre un error y aplica un parche directamente en producción es una receta para el fallo del sistema. El modelo más seguro es un ciclo cerrado: asignar la responsabilidad, hacer un seguimiento de la remediación, volver a probar la solución y conservar pruebas de que la vulnerabilidad ya no es explotable. La verificación continua, el red-teaming de las correcciones generadas por IA y la integración entre escáneres, plataformas de gestión y los desarrolladores que implementan los cambios son medidas de seguridad esenciales.

Estos cambios ya están en marcha. Claude Mythos Preview simplemente los acelera.

Más allá de la detección: dónde está el valor

Para empresas como Fluid Attacks, este momento refuerza una dirección estratégica en lugar de introducir una nueva. La seguridad de las aplicaciones nunca se ha limitado a la detección de vulnerabilidades. Los programas eficaces requieren una visibilidad continua del código y la infraestructura, una priorización basada en el contexto, orientación práctica para la remediación y la verificación de que las soluciones realmente reducen la exposición al riesgo.

Los agentes de IA pueden mejorar cada una de estas áreas, pero no pueden sustituir la necesidad de un enfoque integrado. Más allá de lo que ahora ofrece la IA en capacidades de detección, sobre todo, y de remediación, la experiencia humana proporciona la interpretación y la priorización que permiten a un CISO tomar decisiones de alto riesgo bajo presión. Es posible que los ingenieros de seguridad ya no sean los principales descubridores; ahora son, sobre todo, decisores.

Incluso en esta era de los agentes, la misión central de una solución sólida de AppSec, como Fluid Attacks, permanece inalterada. Las plataformas más valiosas en el futuro serán aquellas que traduzcan los hallazgos en decisiones prácticas, coordinen la corrección a gran escala, proporcionen evidencia de la reducción de riesgos y se integren en entornos de desarrollo y producción reales. Comunicar ese valor también requiere un cambio: en lugar de enfatizar el volumen de vulnerabilidades encontradas, las organizaciones deben demostrar su capacidad para reducir el riesgo de manera efectiva y consistente.

Conclusiones

Si acaso, el aumento de la velocidad de desarrollo impulsado por la IA puede ampliar la superficie total de ataque. Más código, incluso con menor densidad de vulnerabilidades, aún puede traducirse en más vulnerabilidades en términos absolutos. Las organizaciones no deberían dejarse llevar por una falsa sensación de seguridad ante la promesa de un "salvador de la IA". La carrera entre los atacantes automatizados y los defensores automatizados está en pleno apogeo. Tal vez 18 meses sean el margen de tiempo antes de que capacidades como las de Mythos estén ampliamente disponibles. La pregunta que debe plantearse la dirección no es si deberían adoptar un modelo más avanzado, sino si la organización cuenta con la arquitectura, la gobernanza de identidades y la experiencia humana necesarias para operar en un mundo en el que tanto los atacantes como los defensores la utilizan.

Claude Mythos y Project Glasswing no marcan el fin de la ciberseguridad tal como la conocemos. Marcan una aceleración de tendencias que ya estaban en marcha. El descubrimiento se vuelve más rápido y automatizado. La remediación se queda ligeramente rezagada porque sigue siendo compleja, requiere muchos recursos y depende del contexto (esto no significa que la remediación impulsada por IA no vaya a avanzar pronto). Por ahora, la brecha entre la detección y la acción se convierte en el desafío determinante. Para la industria de la ciberseguridad, la implicación es clara: el futuro pertenece a quienes puedan cerrar esa brecha.

Una solución de AppSec verdaderamente sólida debe ir más allá del razonablemente atractivo descubrimiento de vulnerabilidades de día cero para ofrecer un modelo operativo basado en la integralidad, la escalabilidad, la secuenciación y el control de cambios. Fluid Attacks lo logra, aprovechando la inteligencia artificial, las herramientas de detección y gestión de riesgos y el criterio y la creatividad humanos, para garantizar la seguridad de tu software. Te invitamos a contactarnos para comenzar a disfrutar de nuestra solución de AppSec.

Empieza ya con la solución de ASPM de Fluid Attacks

Suscríbete a nuestro boletín

Mantente al día sobre nuestros próximos eventos y los últimos blog posts, advisories y otros recursos interesantes.

Otros posts