Opiniões

Além da deteção: o que Claude Mythos e Project Glasswing indicam para o futuro da AppSec

Redator e editor de conteúdo

Updated

10 min

Atualmente, o setor de cibersegurança está focado numa narrativa peculiar e aparentemente de elevado risco: um agente autónomo de IA capaz de detetar e explorar vulnerabilidades numa escala antes considerada reservada a atores estatais. No centro desta conversa estão duas iniciativas interligadas da Anthropic, Claude Mythos Preview e Project Glasswing, e as reações que elas suscitaram vão do alarme à rejeição. Nenhuma destas reações é particularmente útil.

Embora a máquina de marketing que rodeia estes lançamentos seja formidável, as potenciais implicações para a segurança de aplicações estão carregadas tanto de verdadeiros avanços técnicos como de incerteza estratégica. Em vez de perguntar se o Mythos é revolucionário ou exagerado, surge uma questão mais útil: o que este momento revela sobre a direção da segurança de aplicações? E, mais importante, o que é que isto exige das organizações que precisam de defender hoje sistemas do mundo real?

O que a Anthropic colocou em cima da mesa

Claude Mythos Preview é descrito como um modelo de fronteira, especificamente aperfeiçoado para tarefas de raciocínio de alto nível e segurança informática. Enquanto os LLMs anteriores se concentravam principalmente na análise estática para detetar, por exemplo, injeções SQL típicas em excertos de código, o Mythos opera como um sistema autónomo ("agentic"). O seu aspeto mais marcante não reside numa única funcionalidade, mas na combinação de capacidades: lê e raciocina sobre bases de código massivas, formula hipóteses sobre vulnerabilidades, testa dinamicamente essas hipóteses, encadeia múltiplas fragilidades em caminhos de ataque viáveis e gera exploits funcionais juntamente com relatórios reproduzíveis.

No entanto, como Rafael Álvarez, cofundador da Fluid Attacks, observa no seu blog pessoal, este tipo de capacidade não surge de um modelo isolado, mas de um sistema mais amplo: uma estrutura que envolve um sistema em execução, o seu código-fonte, ferramentas determinísticas que o modelo orquestra… e um humano que compõe e valida os resultados.

O fluxo de trabalho do Mythos é normalmente estruturado da seguinte forma: o projeto em questão é carregado para um contentor seguro, isolado da Internet, no qual operam várias instâncias do modelo. O modelo analisa então toda a base de código e classifica os arquivos pela sua relevância em termos de segurança, numa escala de 1 a 5 (p.ex., um arquivo que analisa dados brutos da internet recebe um "5", enquanto um arquivo de configuração pode receber um "1"). Usando o Claude Code, o modelo formula hipóteses sobre potenciais falhas, escreve lógica de depuração, executa o código para confirmar as suas suspeitas e itera.

A etapa de priorização também é fundamental para ampliar o alcance das avaliações. Em vez de analisar repositórios inteiros de forma uniforme, o sistema classifica os arquivos com base na probabilidade de conterem falhas exploráveis. Ele aloca primeiro agentes paralelos às áreas de maior risco, o que reduz a duplicação e aumenta a eficiência em bases de código de grande porte.

Quando encontra algo, o Mythos constrói autonomamente um exploit de prova de conceito. Em seguida, uma instância separada do agente atua como juiz, revisando cada descoberta e filtrando problemas menores ou pouco relevantes, retendo apenas os de elevada gravidade, que são validados por avaliadores humanos antes de serem divulgados. De acordo com relatos, avaliações internas indicam que o modelo identificou vulnerabilidades que persistiam há décadas, incluindo problemas em sistemas operativos e bibliotecas amplamente utilizadas que já tinham sido exaustivamente escrutinadas por outros métodos.

É difícil ignorar tais relatos. Por exemplo, a Anthropic afirma que o Mythos detetou uma vulnerabilidade de 27 anos no kernel do OpenBSD, relacionada às opções TCP SACK, bem como um bug de 16 anos no FFmpeg que sobreviveu a milhões de testes automatizados. Segundo a empresa, o modelo também combinou várias vulnerabilidades do kernel Linux para obter escalada de privilégios local por conta própria. Além disso, afirma que a taxa de sucesso na geração de exploits funcionais é superior a 72%, o que representa um salto dramático em comparação com modelos anteriores (incluindo o recente Opus 4.6), que apresentavam dificuldades significativas com vulnerabilidades de dia zero.

Por outro lado, Project Glasswing é a resposta defensiva às capacidades mencionadas acima. Reconhecendo que lançar uma ferramenta deste tipo sem salvaguardas poderia ter consequências catastróficas, a Anthropic reuniu um consórcio de empresas de tecnologia e segurança, incluindo AWS, Google, Microsoft, NVIDIA, Cisco, CrowdStrike e Palo Alto Networks. A iniciativa é apoiada por 100 milhões de dólares em créditos de uso de modelos e por 4 milhões de dólares em doações a organizações de segurança de código aberto, como a Alpha-Omega e a OpenSSF.

O objetivo declarado é dar a estes parceiros e aos mantenedores de código aberto acesso a modelos como o Mythos, para que possam identificar e corrigir vulnerabilidades em infraestruturas críticas de software antes que atacantes maliciosos possam tirar proveito de capacidades semelhantes. À primeira vista, isto faz lembrar colaborações anteriores da indústria. No entanto, a premissa subjacente é diferente: se a descoberta de vulnerabilidades se tornar drasticamente mais fácil e rápida, o manual inteiro das estratégias defensivas deve mudar.

Na prática, o Glasswing não é apenas um acordo de colaboração, mas também um ambiente de testes operacionais. As organizações participantes utilizam o Mythos Preview para realizar tarefas como testes de caixa-preta de binários, análises de segurança de terminais e detecção de vulnerabilidades tanto em sistemas proprietários quanto em sistemas de código aberto, e os resultados são incorporados a processos coordenados de divulgação e correção.

Evidência, ceticismo e timing estratégico

O debate em torno do Mythos assenta numa mistura de evidências verificáveis e incertezas. Por um lado, as alegações sobre mudanças de paradigma impulsionadas por IA tornaram-se comuns, e muitos profissionais desconfiam de retórica de marketing disfarçada de ambição técnica. Por outro lado, há evidência tangível de vulnerabilidades reais descobertas e remediadas em sistemas amplamente utilizados, e organizações respeitadas juntaram-se em torno de uma preocupação compartilhada.

Estas são contribuições concretas, não demonstrações hipotéticas. Mesmo assim, as evidências públicas continuam sendo muito mais escassas do que o conjunto de alegações (aparentemente, os prazos de divulgação responsável impedem uma inspeção completa). A Anthropic afirma que menos de 1% das vulnerabilidades potenciais descobertas até agora foram totalmente corrigidas e que identificou "milhares" de vulnerabilidades de severidade alta e crítica. No entanto, nesta fase, o registro público consiste principalmente em um conjunto limitado de hashes SHA-3 — que somam pouco mais de 15 até o momento — e apenas em um CVE explicitamente atribuível ao Glasswing: CVE-2026-4747, listado no NVD como um estouro de buffer baseado na pilha do FreeBSD RPCSEC_GSS.

Os detalhes operacionais fundamentais também permanecem pouco claros. Álvarez assinala que métricas como as taxas de falsos positivos, o custo em tokens e os fluxos de validação não foram divulgados, o que dificulta a avaliação da verdadeira eficiência e confiabilidade do processo na prática.

Esta ambiguidade alimenta um ciclo familiar de hype e contra-hype, no qual coexistem tanto o otimismo quanto o medo exagerados. Vale a pena manter uma dose saudável de ceticismo e perguntar por que escolheu a Anthropic este momento específico para enquadrar o seu modelo como demasiado perigoso para ser lançado ao público. A empresa, por exemplo, está numa corrida feroz com a OpenAI pela liderança de mercado e, segundo relatos, prepara-se para uma oferta pública inicial (IPO). Um modelo posicionado como demasiado poderoso para ser lançado é uma narrativa convincente para investidores e para assegurar financiamento nos próximos anos. Alguns críticos apelidaram isto de "criti-hype", uma dinâmica em que os avisos sobre os perigos de uma tecnologia inflacionam o seu valor percebido. Se uma ferramenta for suficientemente poderosa para desestabilizar a Internet, segundo este argumento, também tem de ser suficientemente poderosa para justificar uma valorização de vários milhares de milhões. Outros observadores veem tudo isto como sinais iniciais de um verdadeiro ponto de inflexão.

Uma leitura equilibrada reconhece ambos os elementos. É inegável que existe uma estratégia de marketing por trás disto, mas também há substância técnica suficiente para merecer atenção séria. O paralelo histórico é instrutivo: na época, o GPT-2 foi considerado demasiado perigoso para ser lançado no mercado, mas acabou por ser disponibilizado ao público sem que ocorresse a catástrofe prevista. Alguns analistas suspeitam que o Mythos está simplesmente numa fase beta e que o discurso de segurança serve como cobertura conveniente para afinar arestas com parceiros de confiança antes de um lançamento mais amplo. Em qualquer caso, tudo isto cria uma tensão natural: está a ser pedido à indústria que se prepare para lidar com capacidades que ainda não podem ser totalmente avaliadas.

Essa tensão se intensificou ainda mais logo após os anúncios da Mythos e da Glasswing. Alguns pesquisadores relataram o que descreveram como uma falha sistêmica no protocolo de contexto do modelo (MCP) da Anthropic, relacionada a configurações baseadas em STDIO que poderiam levar à execução de comandos arbitrários nas implementações afetadas. Segundo eles, o problema afetava grande parte da cadeia de suprimentos de IA, e a Anthropic confirmou que esse comportamento faz parte do projeto, deixando a sanitização a cargo dos desenvolvedores em vez de modificar o protocolo. Isso ocorreu após outro incidente em que o Claude Code foi distribuído ao npm com um mapa de origem não intencional que expôs mais de 500 mil linhas de código-fonte proprietário, o que a Anthropic atribuiu a um erro humano, em vez de uma falha de segurança. Nenhum dos episódios refuta as capacidades do Mythos, mas ambos reforçam um ponto incômodo: mesmo os criadores de ferramentas de segurança de ponta continuam sujeitos às mesmas realidades caóticas do design de software, das cadeias de suprimentos, dos processos de lançamento e dos descuidos humanos que todos os demais.

Acesso restringido e a questão da equidade

A decisão de limitar o Mythos a um grupo fechado de parceiros validados suscita um conjunto distinto de preocupações. Ao concentrar as ferramentas defensivas mais poderosas por detrás de um consórcio de gigantes tecnológicos, a Anthropic corre o risco de criar um cenário de segurança de dois níveis. Grandes empresas com recursos para participar no Glasswing terão acesso antecipado a estas capacidades. Pequenas e médias empresas, incapazes de suportar os preços futuros ou os requisitos de infraestrutura para correr estes agentes, poderão encontrar-se permanentemente em desvantagem, enfrentando atacantes potencializados por IA, mas sem defesas de nível de IA.

Há também questões em aberto sobre a governação e a dependência. As organizações que dependem de ferramentas do tipo Mythos através do Glasswing tornam-se dependentes das decisões da Anthropic sobre acesso, preços e disponibilidade contínua. A centralização deste tipo merece escrutínio, especialmente quando está em causa infraestrutura crítica.

A verdadeira mudança: a descoberta torna-se um bem comum

A implicação mais significativa do Mythos e do Glasswing não é a descoberta de novas falhas. É a desvalorização da própria descoberta. Estamos a aproximar-nos de uma realidade em que a deteção de vulnerabilidades é abundante e barata, o que significa que já não é o principal fator diferenciador de uma solução de AppSec; no entanto, a capacidade de corrigir esses problemas continua a ser parcialmente humana, finita e — no caso do código aberto — largamente voluntária. O estrangulamento passa do investigador de segurança para o mantenedor de software. Esta mudança também expõe um problema mais imediato: a maioria das organizações já tem conhecimento de muitas das suas vulnerabilidades e simplesmente não as está a remediar. Como observa Álvarez, o problema muitas vezes não é a descoberta, mas a disciplina — as equipas sabem exatamente o que está quebrado, mas não o estão a corrigir.

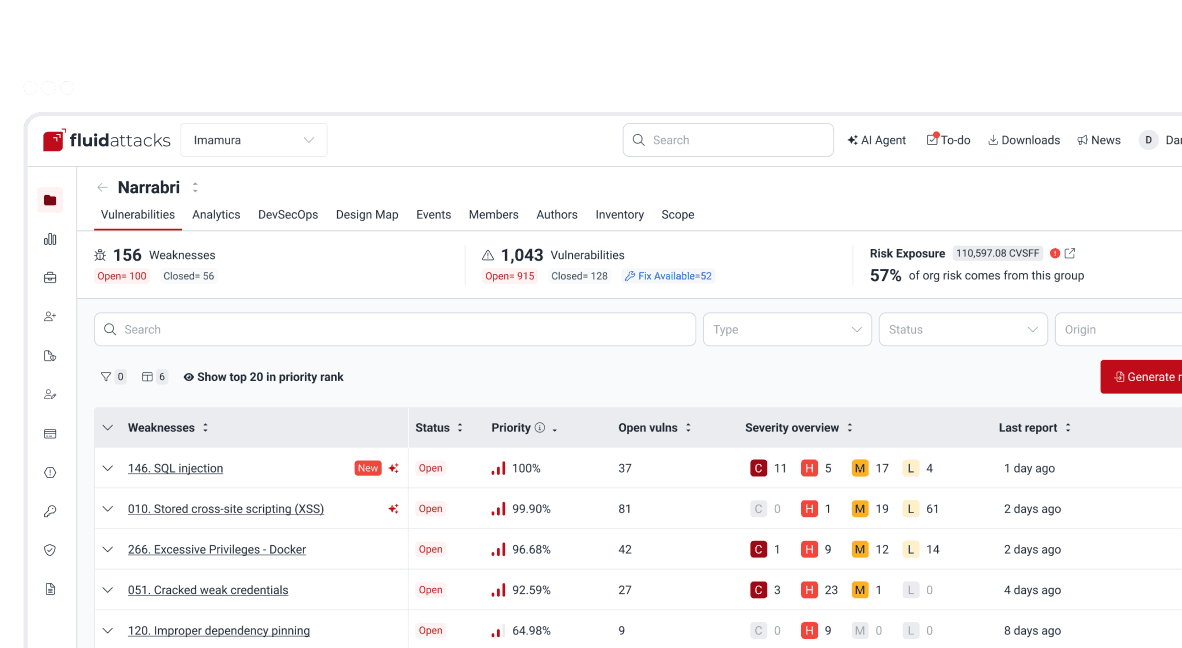

Isto não é teórico. Muitas organizações já estão a acumular mais descobertas do que conseguem tratar razoavelmente. Ferramentas como o Mythos levariam essa tendência ao extremo. As ferramentas ficaram mais rápidas, a cobertura melhorou e a pilha de descobertas por resolver continuou a crescer. Talvez o que esteja a faltar agora não seja mais deteção. Seja a capacidade de compreender e decidir quais são os problemas mais importantes, priorizá-los com base no contexto, corrigi-los com segurança e verificar que o risco diminuiu efetivamente. Isso também requer uma visão normalizada e centralizada das descobertas em todas as fontes; caso contrário, os relatórios gerados por IA se tornam mais um silo adicionado às saídas dos scanners, relatórios de testes de penetração, tickets e planilhas.

A Anthropic também destaca que os testes de desempenho tradicionais já não são suficientes para avaliar esses sistemas, uma vez que os modelos podem memorizar vulnerabilidades conhecidas. Em vez disso, a empresa concentra-se na descoberta de vulnerabilidades de dia zero como um indicador mais confiável da capacidade real, já que tais descobertas não podem ser derivadas dos dados de treinamento.

O peso para os mantenedores e o atraso de CVEs

Para os programadores de código aberto, a enxurrada de relatórios de vulnerabilidades gerados por IA é uma faca de dois gumes. Os mantenedores de alguns projetos reconheceram que os relatórios de IA estão a melhorar em termos de qualidade, passando do ruído a algo genuinamente útil. Mas mesmo um relatório de alta qualidade exige tempo humano para validar, integrar e testar. A capacidade de absorver esse volume de descobertas e de as remediar não escala da mesma forma que a descoberta.

Além disso, o ecossistema de CVEs existente já está sob pressão. Um aumento exponencial na descoberta de vulnerabilidades poderá sobrecarregar a infraestrutura de triagem, gerando atrasos que se estendem por meses. Isto cria uma perigosa "lacuna de conformidade": os calendários tradicionais de correção tornam-se obsoletos quando um adversário pode passar da descoberta ao exploit em minutos.

IA dos dois lados

A detecção de vulnerabilidades impulsionada por IA não é uma possibilidade futura. Os adversários já estão a usar IA para escalar as suas operações. Os modelos não precisam de atingir as capacidades do Mythos para serem eficazes; mesmo sistemas moderadamente capazes aceleram o reconhecimento, o desenvolvimento de exploits e a automatização de ataques. Já vimos esquemas automatizados de extorsão de dados e campanhas de "vibe hacking" que antes exigiam equipas inteiras de criminosos. Os defensores são obrigados a responder com ferramentas semelhantes, mas a velocidade por si só não é suficiente. As organizações também têm de melhorar a qualidade da tomada de decisão sob pressão temporal.

Vale ressaltar que uma das capacidades mais relevantes, do ponto de vista técnico, do Mythos é a de encadear múltiplas vulnerabilidades para contornar mecanismos de defesa em camadas, como o KASLR (kernel address space layout randomization) ou o isolamento em ambientes de teste. Isso reflete uma mudança em que as medidas de mitigação baseadas no aumento do esforço do invasor, em vez de impor restrições rígidas, podem se mostrar menos eficazes diante de fluxos de trabalho assistidos por IA.

Incertezas críticas

Apesar do impulso atual, várias limitações merecem ser reconhecidas. Em primeiro lugar, nenhum sistema, seja de IA ou não, pode, de forma realista, garantir cobertura completa de vulnerabilidades. Técnicas diferentes revelam classes distintas de problemas, e os falsos negativos continuam a ser uma preocupação fundamental. Há também uma limitação mais profunda. Como explica Álvarez, a segurança de software não é um problema totalmente solucionável no caso geral: determinar se um programa está livre de vulnerabilidades está sujeito aos mesmos limites teóricos descritos pelo teorema de Rice. Na prática, isto significa que qualquer ferramenta — baseada em IA ou não — operará sempre por aproximação, equilibrando falsos positivos e falsos negativos.

Em segundo lugar, a suposição de que a descoberta se tornará trivial pode ser exagerada. Embora a IA possa melhorar significativamente a eficiência, a validação em grande escala e com elevada confiança continua a exigir recursos, contexto e julgamento humano. E o ecossistema mais vasto, em particular os mantenedores de código aberto, pode simplesmente não ter capacidade para absorver o aumento do volume de descobertas.

Além disso, os centros de dados contam com processos de aplicação de patches relativamente maduros, mas o mundo da tecnologia operacional, da IoT e dos sistemas ciberfísicos não. Não existe um equivalente ao Windows Update para o controlador de uma bomba de uma estação de tratamento de água. Se a descoberta de vulnerabilidades se tornar agnóstica em relação ao sistema operativo, mas a remediação continuar a ser específica do hardware e do ambiente, enfrentaremos uma vaga de vulnerabilidades de dia zero em sistemas que nunca foram concebidos para receber patches em grande escala.

O que isto significa para os programas de segurança

Em conjunto, estas tendências apontam para uma mudança estrutural, e não para um único avanço tecnológico. Dela decorrem várias consequências potenciais:

Os testes de penetração realizados por especialistas e a análise de vulnerabilidades com ferramentas determinísticas continuarão a perder valor significativo se não forem usados em conjunto com modelos avançados de IA e não fizerem parte de programas de segurança abrangentes.

Novos modelos de serviço — como o que a Fluid Attacks já estabeleceu e ofereceu há anos — irão surgir em torno de soluções que integrem a detecção, a priorização, a remediação e a verificação em um fluxo de trabalho contínuo.

Os papéis na área da segurança evoluirão, e as competências mais procuradas passarão de detetar vulnerabilidades em sistemas para orquestrar agentes de IA, validar os seus resultados com precisão e tomar decisões de alto impacto sobre a priorização e a mitigação de riscos.

A principal questão que as organizações colocam ao avaliar fornecedores de segurança deixará de se centrar tanto nas capacidades de deteção de vulnerabilidades, passando a concentrar-se antes nas competências para validar com exatidão as descobertas, priorizá-las com base no contexto e promover uma remediação rápida e contínua em escala.

À medida que a segurança impulsionada por IA se torna mais prevalente, os requisitos regulamentares de auditabilidade, supervisão e responsabilização vão se expandir. O EU AI Act e os enquadramentos do NIST já apontam nessa direção, e o "devido cuidado" passará cada vez mais a exigir supervisão humana documentada das descobertas automatizadas.

Uma IA autônoma que detecta um erro e aplica uma correção diretamente em produção é uma receita para a falha do sistema. O modelo mais seguro é um ciclo fechado: atribuir a responsabilidade, acompanhar a remediação, testar novamente a correção e manter registros comprovando que a vulnerabilidade não pode mais ser explorada. A verificação contínua, a avaliação colaborativa das correções geradas pela IA e a integração entre scanners, plataformas de gerenciamento e os desenvolvedores que implementam as alterações são medidas de segurança essenciais.

Essas mudanças já estão em andamento. O Claude Mythos Preview simplesmente as acelera.

Para além da deteção: onde está o valor

Para empresas como a Fluid Attacks, este momento reforça uma direção estratégica em vez de introduzir uma nova. A segurança de aplicações nunca se limitou a encontrar vulnerabilidades. Programas eficazes exigem visibilidade contínua do código e da infraestrutura, priorização consciente do contexto, orientação prática para remediação e verificação de que as correções reduzem efetivamente a exposição ao risco.

Os agentes de IA podem potenciar cada uma destas áreas, mas não podem substituir a necessidade de uma abordagem integrada. Para além do que a IA oferece atualmente em termos de capacidades de deteção — acima de tudo — e de remediação, a experiência humana fornece a interpretação e a priorização necessárias para que um CISO tome decisões de alto risco sob pressão. É possível que os engenheiros de segurança não sejam mais os principais descobridores; agora eles são, acima de tudo, tomadores de decisão.

Mesmo nesta era agêntica, a missão central de uma solução robusta de AppSec, como a Fluid Attacks, permanece inalterada. As plataformas mais valiosas daqui em diante serão as que transformarem descobertas em decisões acionáveis, coordenarem a remediação em escala, fornecerem evidência de redução de risco e se integrarem a ambientes reais de desenvolvimento e produção. Comunicar esse valor também exige uma mudança: em vez de enfatizar o volume de vulnerabilidades encontradas, as organizações precisam demonstrar a sua capacidade de reduzir o risco de forma eficaz e consistente.

Conclusões

Se é que algo, o aumento da velocidade de desenvolvimento impulsionado pela IA pode ampliar a superfície de ataque total. Mais código, mesmo com menor densidade de vulnerabilidades, ainda pode resultar em mais vulnerabilidades em termos absolutos. As organizações não devem ser embaladas por uma falsa sensação de segurança pela promessa de um "salvador da IA". A corrida entre atacantes e defensores automatizados está em pleno andamento. Talvez faltem apenas 18 meses para que capacidades como as do Mythos se tornem amplamente disponíveis. A questão que a liderança deve colocar não é se deve adotar um modelo mais avançado, mas se a organização tem a arquitetura, a governação de identidades e a experiência humana necessárias para operar num mundo em que atacantes e defensores o utilizam.

Claude Mythos e Project Glasswing não assinalam o fim da cibersegurança tal como a conhecemos. Assinalam uma aceleração de tendências que já estavam em curso. A detecção está a tornar-se mais rápida e automatizada. A remediação fica ligeiramente para trás porque continua a ser mais complexa, mais intensiva em recursos e mais dependente do contexto (isto não significa que a remediação orientada por IA não vá avançar em breve). Por enquanto, a lacuna entre a detecção e a ação torna-se o desafio determinante. Para o setor de segurança cibernética, a implicação é clara: o futuro pertence àqueles que conseguirem preencher essa lacuna.

Uma solução de AppSec verdadeiramente sólida deve ir além da descoberta, razoavelmente atraente, de vulnerabilidades de dia zero para oferecer um modelo operacional baseado na integridade, escalabilidade, sequenciamento e controle de mudanças. A Fluid Attacks consegue isso, aproveitando a inteligência artificial, as ferramentas de detecção e gestão de riscos e o discernimento e a criatividade humanos, para garantir a segurança do seu software. Convidamo-lo a contactar-nos para começar a desfrutar da nossa solução de AppSec.

Comece agora com a solução ASPM da Fluid Attacks

Assine nossa newsletter

Mantenha-se atualizado sobre nossos próximos eventos e os últimos posts do blog, advisories e outros recursos interessantes.

Outros posts