Opiniões

Como comparar ferramentas de segurança de aplicações: guia para tomadores de decisão

Redator e editor de conteúdo

7 min

Há bastante tempo, em nossas conversas com empresas de todos os setores, identificamos o quanto é difícil para você decidir qual solução de segurança de aplicações adotar. A informação disponível simplesmente não basta; mesmo depois de analisar os sites dos fornecedores e relatórios de analistas com seus quadrantes gerais, ou ao assistir as demos de vendas, que mostram apenas os melhores cenários possíveis, não é fácil saber como uma ferramenta vai realmente se comportar em relação ao seu código, nos seus pipelines, com os seus desenvolvedores, etc. Concluímos que o mais adequado é oferecer um processo estruturado e baseado em evidências para comparar soluções nas dimensões mais relevantes: efetividade de detecção, compatibilidade operacional, adoção pelos desenvolvedores e impacto nos negócios.

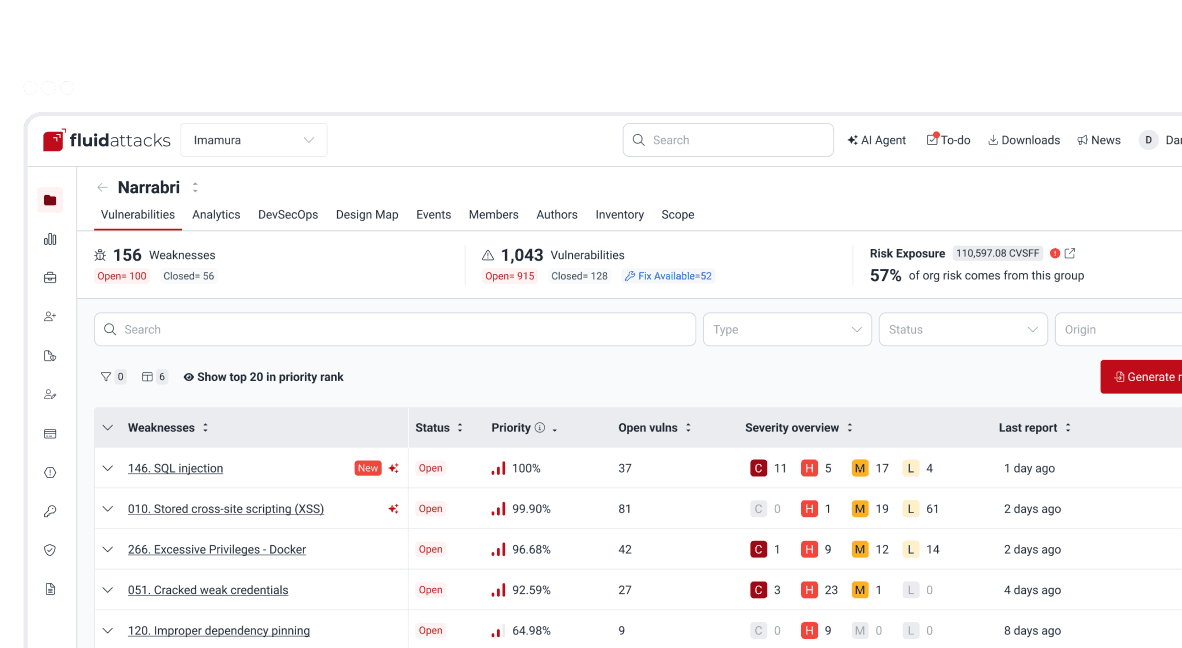

Este guia se baseia na nossa experiência como empresa de AppSec que já testou ferramentas — as própias e as de terceiros — em aplicações reais, medindo o que detectam, o que deixam passar e quanto custa agir com base nos resultados que geram. Uma conclusão a que chegamos de forma recorrente é que nenhuma ferramenta automatizada, isoladamente, oferece um panorama completo da exposição ao risco de uma aplicação. A abordagem híbrida, que combina escaneamento automatizado com pentesting especializado em uma única plataforma, entrega a acurácia de detecção e a clareza operacional de que as organizações realmente precisam. Nosso benchmark de 36 ferramentas de terceiros confirmou isso: o scanner com melhor desempenho detectou 22,7% das vulnerabilidades, enquanto nossos pentesters identificaram 89,6%.

Seja para preparar uma decisão de compra, assessorar uma avaliação técnica ou analisar ofertas concorrentes, o framework apresentado a seguir vai ajudá-lo a comparar soluções de AppSec com rigor e confiança.

1. Comece pelo propósito da comparação

Antes de abrir qualquer dashboard, esclareça o que você pretende alcançar. O propósito do benchmark determina quais critérios têm maior peso.

Se você é um comprador avaliando fornecedores, vai priorizar a acurácia de detecção, a facilidade de integração e o custo total de propriedade.

Se é um líder de segurança avaliando suas ferramentas atuais, o recall e a taxa de falsos negativos se tornam fundamentais, já que a pergunta é "o que estamos deixando passar?".

Se a comparação alimenta uma análise de go-to-market, o posicionamento competitivo e a diferenciação são o que mais importa.

Se o benchmark apoia uma avaliação de M&A ou parceria, a escalabilidade e a compatibilidade arquitetural assumem o protagonismo.

Defina esse objetivo de forma explícita e documente sua decisão. Ele será a âncora de toas as decisões seguintes.

2. Delimite o escopo técnico

"Segurança de aplicações" é um conceito amplo demais para funcionar como categoria de benchmark. É preciso especificar quais métodos de teste e contextos serão comparados:

SAST (análise estática de código-fonte)

DAST (testes dinâmicos de aplicações em execução)

SCA (análise de composição de software para dependências de terceiros)

IAST / RASP (instrumentação e proteção em tempo de execução)

Pentesting (avaliação de segurança manual e feita por especialistas)

ASM / CAASM (gestão de superfície de ataque)

Segurança cloud, de API ou de infraestrutura

Além disso, é necessário considerar o stack tecnológico e o modelo de implementação preferido. Um benchmark bem delimitado poderia ser formulado assim: "Comparação de SAST e SCA para pipelines de CI/CD com repositórios backend em Java e Node.js." Esse nível de especificidade evita comparações desiguais e mantém a avaliação focada no seu ambiente real.

3. Monte um ambiente de teste controlado

Lembre-se de que as demos guiadas pelo fornecedor são projetadas para exibir pontos fortes, não para revelar lacunas. É preciso testar as soluções em um ambiente que você controle.

Selecione aplicações realistas: O ideal é utilizar duas ou três aplicações reais de stacks tecnológicos distintos: por exemplo, um serviço backend em Java ou Node.js, um frontend SPA e uma API. Cada aplicação deve ser grande e complexa o suficiente para gerar uma amostra significativa de achados; um único repositório de poucos milhares de linhas não vai produzir o volume nem a variedade necessários para se chegar a conclusões confiáveis. Inclua tanto CVEs conhecidos em dependências quanto falhas originais no nível de aplicação, já que ferramentas que funcionam bem em vulnerabilidades catalogadas costumam ter dificuldades com questões de lógica de negócio.

Padronize as condições: Cada ferramenta avaliada deve escanear o mesmo commit, na mesma configuração de pipeline, com a mesma janela de execução e com políticas configuradas da forma mais equivalente possível. Sem condições controladas, você estará medindo diferenças de configuração e não capacidade de detecção.

4. Meça métricas técnicas-chave

4.1. Acurácia

Medir a acurácia exige rastrear três valores em cada ferramenta:

Verdadeiros positivos (TP): vulnerabilidades reais corretamente identificadas

Falsos positivos (FP): itens que não são vulnerabilidades, mas que são sinalizados como tal

Falsos negativos (FN): vulnerabilidades reais que a ferramenta não detectou

A partir desses valores, derivam-se duas métricas essenciais. A precisão (TP / [TP + FP]) indica que proporção do resultado é de fato acionável. O recall (TP / [TP + FN]) indica que proporção do risco real está sendo detectada.

É fundamental prestar atenção a ambas. Uma ferramenta que reporta pouquíssimos falsos positivos parece eficiente, mas se alcança essa baixa taxa de FP porque também deixa escapar uma grande parte das vulnerabilidades reais, ela está oferecendo uma visão perigosamente incompleta do risco. No nosso estudo de benchmark, o scanner automatizado com o maior número de verdadeiros positivos ainda assim deixou de detectar quase 80% do universo de vulnerabilidades. O recall, sobretudo para vulnerabilidades de severidade alta e crítica, é a métrica que separa uma segurança aceitável de uma proteção genuína.

4.2. Qualidade dos achados

Contar as detecções não é suficiente. Para cada achado, avalie o seguinte:

Explorabilidade: Trata-se de uma fraqueza teórica ou de uma vulnerabilidade que pode ser explorada na prática?

Evidência: O achado inclui uma prova de conceito ou um caminho de exploração claro? Os achados sem evidência geram sobrecarga de triagem e corroem a confiança do desenvolvedor.

Contexto de negócios: O relatório ajuda a entender o impacto real da vulnerabilidade sobre a aplicação e os dados específicos da organização?

Acurácia na priorização: A severidade atribuída (CVSS ou equivalente) é realista ou é necessária outra métrica? As métricas baseadas em risco, como nosso CVSSF, e um conjunto de fatores como alcançabilidade, custo de remediação e status no KEV ajudam as organizações a ir além dos números brutos de severidade, rumo a uma imagem mais precisa da exposição ao risco agregado.

4.3. Desempenho

Meça a pegada operacional de cada ferramenta:

Duração da análise: Tempo total desde a execução até a entrega dos resultados

Impacto no CI/CD: O escaneamento bloqueia o pipeline? Se sim, por quanto tempo? É possível executá-la de forma incremental ou ela exige uma análise completa a cada vez?

Consumo de recursos: CPU, memória e carga de rede durante a execução, particularmente importante em escala

5. Avalie a experiência do desenvolvedor

Uma ferramenta que os desenvolvedores evitam ou na qual não confiam gera menos remediação, tempos de correção mais longos e menor adoção, independentemente de quão exata seja sua detecção.

Peça que um desenvolvedor real da sua equipe avalie cada ferramenta nos seguintes aspectos:

Fricção no onboarding: Quanto tempo um desenvolvedor leva do primeiro acesso até compreender e agir sobre um achado?

Clareza dos achados: Os achados estão escritos em linguagem que os desenvolvedores entendem, com contexto suficiente para reproduzir e corrigir o problema?

Orientação de remediação: A ferramenta fornece sugestões específicas no nível do código ou apenas descrições genéricas de CWE?

Profundidade de integração: Ela funciona dentro dos ambientes que seus desenvolvedores já utilizam, como GitHub, GitLab ou Jira? Os achados aparecem nos pull requests?

Eficiência do fluxo de trabalho: Quantos passos são necessários para ir de uma vulnerabilidade reportada a uma issue encerrada? A implementação de IA e a redução de cliques e trocas de contexto significam uma remediação mais rápida.

6. Avalie a capacidade operacional

Os testes de segurança não se resumem a achados; trata-se de a solução conseguir operar de forma confiável na escala da sua organização e dentro dos seus requisitos de governança. Portanto, considere o seguinte:

Escalabilidade: Teste o comportamento à medida que o volume aumenta. Suponha que uma ferramenta funcione bem com 10 repositórios. Ela ainda mantém o mesmo desempenho com 100, com 1.000? Avalie o suporte multi-tenant, o desempenho sob análises concorrentes e os rate limits da API.

Governança e gestão: Observe como a solução lida com políticas de segurança, fluxos de exceção, acompanhamento de SLA sobre achados abertos e estratégias de reteste. Ela consegue executar escaneamentos inteligentes e incrementais, ou cada alteração dispara uma análise completa? É possível definir políticas de break the build que bloqueiem o deploy quando existirem vulnerabilidades nã aceitas? Nossos dados mostram que organizações que quebram o build remediaram vulnerabilidades 50% mais rápido do que as que não o fazem.

7. Quantifique o valor de negócio

Para os tomadores de decisão executivos, o benchmark precisa se traduzir em termos de negócio:

Custo total de propriedade (TCO): Inclua as taxas de licenciamento, os custos de infraestrutura e o esforço humano necessário para operar e triar os resultados da ferramenta. Uma ferramenta mais barata que gera alta carga de triagem pode custar mais na prática do que uma solução mais cara, porém mais exata.

Redução de risco: Acompanhe as vulnerabilidades de severidade crítica e alta encerradas por mês e o tempo médio de remediação (MTTR). Essas são as métricas que conectam o investimento em AppSec a uma melhoria mensurável da segurança.

Adoção pelos desenvolvedores: Meça quantas equipes de desenvolvimento utilizam ativamente a ferramenta e como ela afeta seus fluxos de trabalho. Prefira uma solução que elimine os silos de dados, já que eles mantêm as taxas de remediação baixas.

8. Utilize um scorecard ponderado

Depois de reunir dados em todas as dimensões, estruture sua comparação com um scorecard ponderado. Atribua pesos com base no objetivo definido no passo 1 e pontue cada solução de forma consistente.

Um exemplo simplificado:

Categoria | Peso | Solução A | Solução B |

|---|---|---|---|

Precisão de detecção (recall) | 30% | 8 | 6 |

Taxa de falsos positivos | 15% | 7 | 9 |

Experiência do desenvolvedor | 20% | 6 | 8 |

Integração com CI/CD | 15% | 9 | 6 |

Capacidade operacional | 10% | 8 | 7 |

TCO | 10% | 6 | 8 |

Total ponderado | 100% | 7.4 | 7.2 |

Os pesos e categorias específicos devem refletir as prioridades da sua organização. O importante é que a pontuação seja explícita e defensável.

9. Documente tudo com evidências

Cada afirmação no seu benchmark deve ser rastreável. Reúna capturas de tela dos achados, logs dos escaneamentos, relatórios de vulnerabilidades exportados e os commits específicos nos quais cada verdadeiro positivo e cada falso positivo foi validado. Essa base de evidências elimina disputas subjetivas e torna a avaliação reprodutível, o que é útil tanto para a tomada de decisão quanto para revisitar a comparação quando as ferramentas lançarem novas versões.

10. Evite erros comuns

Vários padrões podem comprometer o seu benchmark de AppSec:

Comparar listas de features em vez de resultados: A página de features de um fornecedor indica o que uma ferramenta ou serviço diz fazer, não o que de fato faz contra as suas aplicações, portanto, concentre-se em resultados medidos.

Usar apenas aplicações de teste padrão: As aplicações intencionalmente vulneráveis são un bom ponto de partida, mas não representam a complexidade das bases de código reais. Inclua aplicações com lógica de negócios personalizada e arquitetura realista.

Dar demasiada importância a demos guiadas: Uma demonstração controlada pelo fornecedor é otimizada para mostrar o produto no seu melhor cenário. Insista em testar com as suas próprias aplicações, em um ambiente que você administre.

Ignorar os falsos negativos: Uma ferramenta que reporta menos achados não é necessariamente mais exata, já que pode estar deixando de detectar vulnerabilidades reais. Sem medir o recall, não é possível distinguir uma ferramenta ou solução precisa de uma que simplesmente não está enxergando o suficiente.

Excluir os desenvolvedores da avaliação: Se as pessoas que vão remediar as vulnerabilidades não participam da avaliação das ferramentas, corre-se o risco de escolher uma solução que falhe operacionalmente.

Por que vale a pena uma abordagem híbrida tudo em um

Um benchmark conduzido com esse nível de rigor tende a revelar um padrão consistente: nenhuma ferramenta automatizada, por si só, cobre todo o espectro de riscos de uma aplicação, nem mesmo com os avanços recentes da IA (como o AI SAST). Os scanners automatizados se destacam em velocidade, consistência e cobertura de padrões conhecidos de vulnerabilidades; mas sistematicamente deixam passar problemas complexos, de lógica e dependentes de contexto, que constituem os riscos mais severos. Nossos dados mostram que a expertise humana é necessária para detectar quase 99% das vulnerabilidades de severidade crítica.

É por isso que defendemos — e construímos nossa solução de Hacking Contínuo em torno de — um modelo híbrido que integra ferramentas automatizadas potencializadas por IA com pentesting especializado em uma única plataforma. Quando ambos os métodos operam de forma contínua ao longo do SDLC e seus achados convergem para uma visão de gestão unificada de gerenciamento, disponível para os times de Dev e de Sec, as organizações obtêm a profundidade de detecção, a acurácia na priorização e a velocidade de remediação necessárias para reduzir o risco de verdade. O framework de benchmark deste guia ajudará você a verificar essa afirmação por conta própria, com suas aplicações e nos seus termos.

Comece agora com a solução de segurança de aplicações da Fluid Attacks

Assine nossa newsletter

Mantenha-se atualizado sobre nossos próximos eventos e os últimos posts do blog, advisories e outros recursos interessantes.

Outros posts